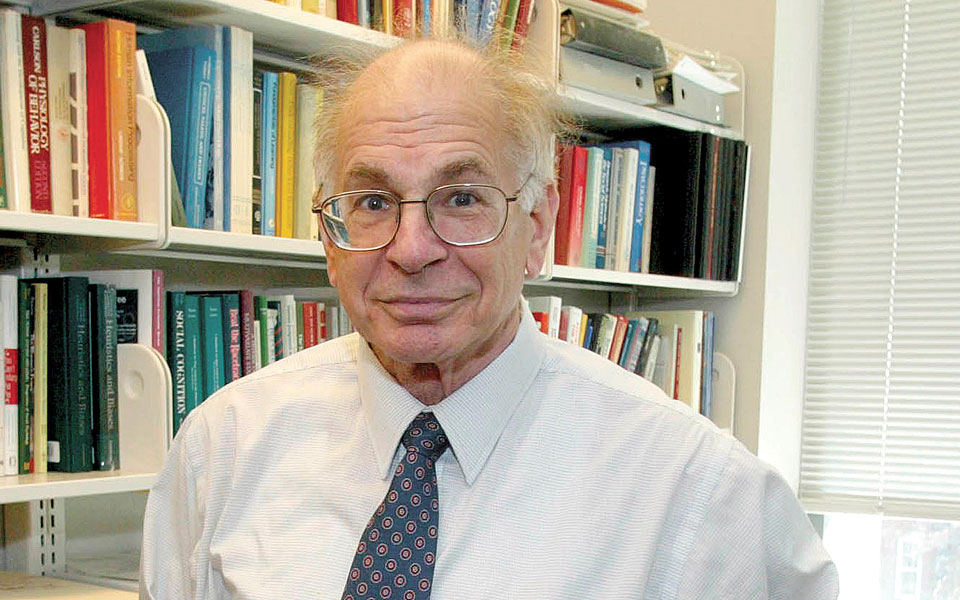

Πώς θα σας φαινόταν αν δύο δικαστές επέβαλαν διαφορετικές ποινές για το ίδιο αδίκημα; Ή αν δύο ακτινολόγοι έκαναν διαφορετική διάγνωση για την ίδια ακτινογραφία; Ή ακόμη χειρότερα αν ο ίδιος δικαστής ή ο ίδιος γιατρός αποφαίνονταν διαφορετικά για όμοιες περιπτώσεις, ανάλογα με τη διάθεσή τους ή την κόπωσή τους; Αυτές οι διακυμάνσεις της ανθρώπινης κρίσης σε πολύ σημαντικούς τομείς είναι αυτό που ο νομπελίστας Ψυχολόγος και Οικονομολόγος, Ντάνιελ Κάνεμαν και οι συνεργάτες του έχουν ορίσει ως «θόρυβο». Ο ομότιμος καθηγητής Ψυχολογίας του Πανεπιστημίου Πρίνστον, Ντάνιελ Κάνεμαν, θεμελιωτής των σύγχρονων συμπεριφορικών οικονομικών, συγγραφέας της χρυσής βίβλου των συμβούλων διοίκησης επιχειρήσεων (Thinking, Fast and Slow), συνθέτει μια αναλυτική προσέγγιση του «θορύβου», των παραγόντων που καθιστούν άστατη την ανθρώπινη κρίση, και προτείνει τρόπους για να περιοριστούν τα σφάλματα που έχουμε μάθει να θεωρούμε συστημικά (Noise: A Flaw in Human Judgment).

Μιλώντας στην «Κ» ο Κάνεμαν απαντά στα διλήμματα που προκύπτουν από τη ραγδαία ανάπτυξη της τεχνητής νοημοσύνης, όπως του ChatGPT, ενώ δεν κρύβει την ανησυχία του για την εποχή αυτονομίας της τεχνητής νοημοσύνης και τις επιπτώσεις που μπορεί να έχει στον ρόλο του ανθρώπου.

– Πώς ορίζετε τον «θόρυβο» και πώς επηρεάζει τη διαδικασία λήψης αποφάσεων;

– Μιλάμε για «θόρυβο» στο πλαίσιο λήψης πολλαπλών αποφάσεων. Μπορεί να υπάρχουν πολλές αποφάσεις για διαφορετικά πράγματα ή πολλές αποφάσεις για το ίδιο πράγμα. Στην πραγματικότητα είναι πιο εύκολο να τις σκεφτούμε ως κρίσεις ή μετρήσεις, οπότε μετράτε είτε διαφορετικά πράγματα είτε το ίδιο πράγμα πολλές φορές. Και υπάρχει και η έννοια του σφάλματος. Ο μέσος όρος αυτών των σφαλμάτων είναι αυτό που αποκαλούμε μεροληψία (bias). Οπότε η μεροληψία είναι ένα προβλέψιμο μέσο σφάλμα. Ομως τα σφάλματα δεν είναι όλα τα ίδια. Κάποια είναι μεγάλα, άλλα είναι μικρά. Ο τεχνικός όρος της περιγραφής μου είναι η «μεταβλητότητα των σφαλμάτων». Είναι πολύ ατυχές γιατί η λέξη «θόρυβος» έχει πολλές διαφορετικές έννοιες και είναι πολύ εύκολο να ξεχάσουμε ποια είναι η τεχνική έννοια. Αλλά η τεχνική έννοια είναι απλώς η «μεταβλητότητα των σφαλμάτων», δηλαδή ότι δεν θέλετε ανεπιθύμητη διακύμανση στις κρίσεις (ίδιων πραγμάτων). Αυστηρά μιλώντας, ο τεχνικός όρος είναι «ανεπιθύμητη μεταβλητότητα στα σφάλματα κρίσης».

– Πιστεύετε ότι θα μπορούσαμε να αποφύγουμε τον «θόρυβο» αν αναθέταμε τη λήψη αποφάσεων σε μηχανές;

– Στο παρελθόν, θα μπορούσαμε να πούμε ότι τα είδη των μαθηματικών αλγορίθμων δεν είχαν «θόρυβο», διότι όποτε τους κάνατε την ίδια ερώτηση, παίρνατε την ίδια απάντηση. Αυτό δεν ισχύει με τους σύγχρονους αλγορίθμους της τεχνητής νοημοσύνης. Αν κάνετε την ίδια ερώτηση στο ChatGPT δύο φορές, δεν θα πάρετε ακριβώς την ίδια απάντηση. Επομένως, υπάρχει κάποιος «θόρυβος». Aλλά σίγουρα υπάρχει πολύ λιγότερος «θόρυβος» στις αλγοριθμικές κρίσεις· ακόμη και όταν πρόκειται για έναν απλό συνδυασμό μεταβλητών, υπάρχει πολύ λιγότερος «θόρυβος» από ό,τι στην ανθρώπινη κρίση.

Μακροπρόθεσμα, το να ζούμε με μια ανώτερη νοημοσύνη είναι μια μεγάλη απειλή. Ετσι, νομίζω ότι πολλοί άνθρωποι ανησυχούν. Το ίδιο και εγώ.

– Θα εμπιστευόταν ο άνθρωπος την απονομή της δικαιοσύνης από ένα άψυχο ον όπως μια μηχανή;

– Νομίζω ότι θα ήταν δύσκολο στην αρχή. Αλλά είναι κάτι που οι άνθρωποι θα μπορούσαν να συνηθίσουν. Για παράδειγμα, έχω ακούσει ότι στην Κίνα πειραματίζονται ώστε οι αποφάσεις των τραπεζών να λαμβάνονται από την τεχνητή νοημοσύνη. Μπορείτε να δείτε ότι σε αυτόν τον στενό τομέα, η χρήση της τεχνητής νοημοσύνης είναι σαφώς καλύτερος τρόπος από την απασχόληση ανθρώπων-κριτών. Ο τρόπος με τον οποίο οι άνθρωποι θα συνηθίσουν τις δικαστικές αποφάσεις που λαμβάνονται από μηχανές θα είναι μια σταδιακή διαδικασία. Αλλά δεν θα με εξέπληττε αν η χρήση της τεχνητής νοημοσύνης επεκταθεί. Για παράδειγμα, οι άνθρωποι αυτή τη στιγμή θέλουν ένα γιατρό να τους πει τι συμβαίνει. Αυτό που θα συμβεί είναι ότι αν ο αλγόριθμος λέει ένα πράγμα και ο γιατρός λέει κάτι άλλο, οι άνθρωποι θα έρχονται σε σύγκρουση. Αυτό που θέλω να πω είναι ότι οι πολίτες μπορούν εύκολα να καταλάβουν ότι ο αλγόριθμος έχει δίκιο και ο γιατρός άδικο. Και επειδή πιστεύω ότι τελικά οι αλγόριθμοι θα έχουν δίκιο πολύ πιο συχνά από ό,τι οι γιατροί, τότε τελικά οι άνθρωποι θα μάθουν να εμπιστεύονται τους αλγορίθμους. Ολα αυτά θα χρειαστούν χρόνο. Αλλά δεν πιστεύω ότι είναι αδύνατον οι άνθρωποι να εμπιστευτούν τους αλγορίθμους.

– Αν επηρεαζόμαστε από τον «θόρυβο», πώς θα μπορούσαμε να αναπτύξουμε έναν δίκαιο αλγόριθμο που να συνδυάζει τη δικαιοσύνη και την ισότητα και να ενσωματώσουμε τις εντολές αυτές σε μια μηχανή;

– Είμαστε πολύ μακριά από αυτό. Ομως, αφενός, σε περιπτώσεις όπως της πτώχευσης, η προσέγγιση είναι αρκετά απλή καθώς υπάρχουν κανόνες, οπότε μπορείτε να γράψετε ένα πρόγραμμα που θα εκτελέσει τους κανόνες και ο νόμος είναι αρκετά συγκεκριμένος. Μπορείτε εκεί να προγραμματίσετε τον αλγόριθμο, ο οποίος θα είναι δίκαιος και ισότιμος. Από την άλλη, για περιπτώσεις όπου το ζήτημα είναι να προσδιοριστεί ποιος λέει την αλήθεια και ποιος όχι, είμαστε πολύ μακριά από το να το αποφασίζουν οι αλγόριθμοι. Βέβαια, ξέρουμε πως ούτε οι άνθρωποι το κάνουν πολύ καλά. Επομένως, υπάρχει σίγουρα περιθώριο βελτίωσης του τρόπου λειτουργίας των κριτών.

– Σας ανησυχεί η ραγδαία ανάπτυξη της τεχνητής νοημοσύνης όπως το ChatGPT χωρίς ανθρώπινα όρια;

– Ανησυχώ, φυσικά και ανησυχώ. Νομίζω ότι όλοι όσοι παρακολουθούν αυτή την κατάσταση ανησυχούν επειδή βραχυπρόθεσμα μπορεί να χρησιμοποιηθεί με τρόπους που θα καταστήσουν τη δημοσιογραφία σχεδόν αδύνατη, επειδή θα είναι τόσο δύσκολο να διακρίνουμε την αλήθεια από τη ψευδή είδηση. Αυτό λοιπόν είναι μόνο ένα πρόβλημα. Και υπάρχουν και άλλα δεκάδες προβλήματα. Μακροπρόθεσμα, το να ζούμε με μια ανώτερη νοημοσύνη είναι μια μεγάλη απειλή. Ετσι, νομίζω ότι πολλοί άνθρωποι ανησυχούν. Το ίδιο και εγώ.

Αν η τεχνητή νοημοσύνη είναι ιδιαίτερα προηγμένη, θα είναι και αυτόνομη

– Αν είχατε τη δύναμη να επιβάλετε έναν κανόνα στην τεχνητή νοημοσύνη, ποιος θα ήταν;

– Λοιπόν, στο Μπέρκλεϊ υπάρχει ένας επιστήμονας πληροφορικής, ο Στιούαρτ Ράσελ, ο οποίος προσπαθεί να διασφαλίσει αυτό που ονομάζεται «ευθυγράμμιση». Δηλαδή ότι η τεχνητή νοημοσύνη θα έχει στόχους που θα συμμορφώνονται με τους ανθρώπινους στόχους. Και αυτό αποδεικνύεται ότι είναι ένα δύσκολο τεχνικό πρόβλημα. Δεν είναι απλό να βεβαιωθείτε ότι ένας αλγόριθμος θα είναι πραγματικά ωφέλιμος, ακόμη και αν του δώσετε ένα στόχο. Το πρόβλημα που απασχολεί πολλούς ανθρώπους είναι ότι μπορεί να αποφασίσει για κάποιους επιμέρους στόχους στον δρόμο προς τον τελικό στόχο, κι έτσι, στα επιμέρους, να προκαλέσει βλάβη στους ανθρώπους. Αν η τεχνητή νοημοσύνη είναι ιδιαίτερα προηγμένη, θα είναι και ιδιαίτερα αυτόνομη. Αυτά, λοιπόν, είναι μερικά από τα τρομερά σενάρια για τα οποία οι άνθρωποι ανησυχούν.

– Είναι λογικό να περιμένουμε να βελτιωθεί η ανθρώπινη νόηση μέσω της χρήσης της τεχνητής νοημοσύνης;

– Η τεχνητή νοημοσύνη θα είναι πολύ χρήσιμη. Είναι ήδη πολύ χρήσιμη για πολλούς ανθρώπους. Αυτό είναι σαφές, αλλά το πρόβλημα είναι ότι σε πολλά επαγγέλματα, οι άνθρωποι μπορεί να χρειάζονται την τεχνητή νοημοσύνη, αλλά η τεχνητή νοημοσύνη μπορεί να μη χρειάζεται τους ανθρώπους. Αυτό είναι το πρόβλημα. Και ξέρετε, αυτό συμβαίνει ήδη, π.χ. στο σκάκι, όπου το λογισμικό είναι πολύ καλύτερο από τους καλύτερους ανθρώπινους παίκτες. Και σε κάθε τομέα όπου η τεχνητή νοημοσύνη κάνει τις ίδιες κρίσεις με τους ανθρώπους με βάση τις ίδιες πληροφορίες, τότε η τεχνητή νοημοσύνη θα είναι πάντα απολύτως ανώτερη από τους ανθρώπους.

– Ποια θα ήταν η συμβουλή σας στις νεότερες γενιές, αποκαλούμενες και ως γενιές του Instagram, που επηρεάζονται συνεχώς από τον «θόρυβο»;

– Δεν έχω καμία συμβουλή για τη νεότερη γενιά. Ξέρετε, θα έπρεπε να γνωρίζω το μέλλον για να δώσω συμβουλές. Και για ένα πράγμα είμαι αρκετά σίγουρος: ότι δεν έχω ιδέα για το τι πρόκειται να συμβεί στο μέλλον, οπότε δεν έχω συμβουλές. Και αυτή στην πραγματικότητα είναι μια καλή, τελική απάντηση.