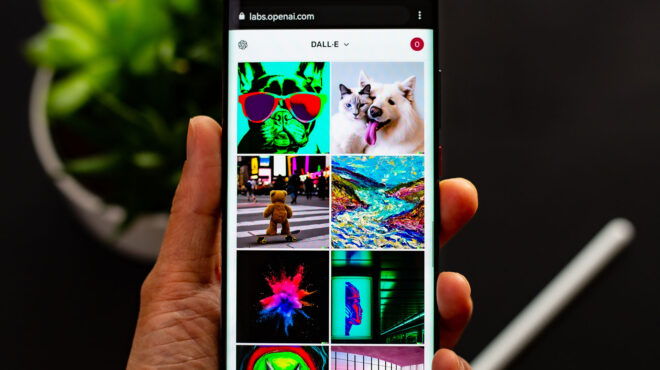

Ενα εργαλείο της OpenAI δίνει τη δυνατότητα στην Τεχνητή Νοημοσύνη να αναγνωρίζει έργα της. Ειδικότερα, το νέο πρόγραμμα μπορεί να ανιχνεύσει αν μια εικόνα έχει δημιουργηθεί από τη «γεννήτρια» μετατροπής κειμένου σε εικόνα της εταιρείας, το περίφημο πρόγραμμα DALL-E 3.

Υπεύθυνοι της OpenAI δήλωσαν ότι το εργαλείο είναι εξαιρετικά ακριβές στην ανίχνευση εικόνων του DALL-E 3, αλλά πρόσθεσαν ότι μικρές, εκ των υστέρων, αλλαγές σε μια εικόνα μπορούν να το μπερδέψουν – γεγονός που αντανακλά το πώς οι εταιρείες τεχνητής νοημοσύνης «πασχίζουν» να βρουν τρόπους ώστε να εντοπίζουν προϊόντα κατασκευασμένα από την ίδια τους την τεχνολογία.

Το νέο εργαλείο της είναι κατά περίπου 98% ακριβές στον εντοπισμό περιεχομένου που δημιουργήθηκε από το DALL-E 3, εφόσον όμως η εικόνα δεν έχει τροποποιηθεί. Οταν οι εικόνες αυτές έχουν αναπαραχθεί μέσω στιγμιότυπου οθόνης (σ.σ. screenshot( ή περικόπτονται) το πρόγραμμα είναι ελαφρώς χαμηλότερο ποσοστό επιτυχίας.

Η απόδοση του εργαλείου μειώνεται περαιτέρω υπό ορισμένες συνθήκες, όπως όταν αλλάζει η απόχρωση αυτών των εικόνων, δήλωσε σε συνέντευξή της η Σαντίνι Αγκαρουάλ, ερευνήτρια την OpenAI που επικεντρώνεται στην πολιτική. Η OpenAI ελπίζει να βρει λύσεις σε αυτά τα προβλήματα.

Το OpenAI δοκιμάζει το εργαλείο ταξινόμησής του εσωτερικά εδώ και μήνες. Δεν βασίζεται σε υδατογραφήματα ή ψηφιακές υπογραφές, που πολλές εταιρείες περιλαμβάνουν σκόπιμα σε εικόνες AI, αλλά συχνά μπορούν να αφαιρεθούν.

Ενώ το εργαλείο της OpenAI διακρίνει αν οι εικόνες έχουν δημιουργηθεί με το DALL-E 3, η εταιρεία διαπίστωσε ότι μπορεί να μπερδευτεί όταν του ζητείται να αξιολογήσει εικόνες AI που έχουν δημιουργηθεί από ανταγωνιστικά προϊόντα. Η αλλαγή της απόχρωσης αυτών των εικόνων μπορεί επίσης να οδηγήσει σε σημαντική μείωση των επιδόσεων, παραδέχτηκε η Αγκαρουάλ.

Στο 0,5%, το εργαλείο επισημαίνει εσφαλμένα ως ψεύτικες εικόνες, στιγμιότυπα που δεν έχουν δημιουργηθεί από τεχνητή νοημοσύνη ως παραγόμενες από το DALL-E 3, δήλωσε η εταιρεία.

Η έξαρση των πλαστών εικόνων που δημιουργήθηκαν με τη χρήση παραγωγικής τεχνητής νοημοσύνης δημιούργησε σε ορισμένες περιπτώσεις σύγχυση σχετικά με το τι είναι και τι δεν είναι αληθινό και τροφοδότησε συζητήσεις σχετικά με τον τρόπο που οι εικόνες επηρεάζουν τις προεκλογικές εκστρατείες του 2024.

Πολιτικοί και νομοθέτες ανησυχούν ολοένα και περισσότερο ότι ψηφοφόροι συναντούν όλο και πιο συχνά εικόνες που έχουν δημιουργηθεί με τεχνητή νοημοσύνη στο διαδίκτυο, και η δημοφιλία εργαλείων όπως το DALL-E 3 καθιστά δυνατή την ακόμη ταχύτερη δημιουργία τέτοιου περιεχομένου. Αλλες νεοσύστατες επιχειρήσεις AI και εταιρείες τεχνολογίας δημιουργούν επίσης εργαλεία για να βοηθήσουν.

Η ανησυχία για τις εκλογές «ωθεί» αρκετές από αυτές τις πρωτοβουλίες δήλωσε ο Ντέιβιντ Ρόμπινσον, ο οποίος επιβλέπει τον σχεδιασμό πολιτικής για το OpenAI. «Είναι η μεταλύτερη ανησυχία από τους υπεύθυνους χάραξης πολιτικής».

Πηγή Wall Street Journal