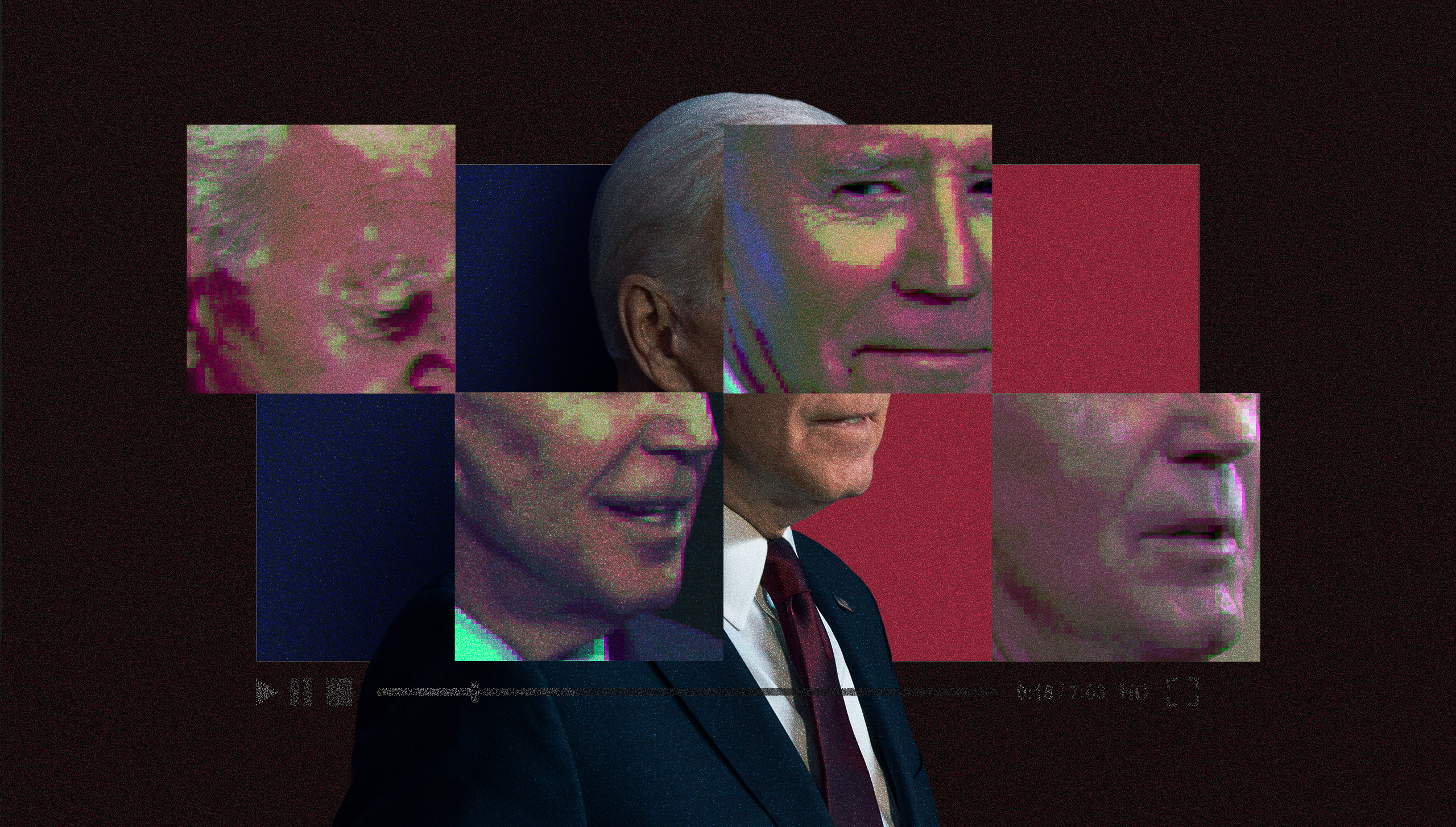

Πριν από μερικές ημέρες, κάτοικοι του Νιού Χαμσάιρ, λίγες ώρες πριν τις προκριματικές εκλογές της πολιτείας, δέχθηκαν ένα φωνητικό μήνυμα, υποτίθεται, από τον Τζο Μπάιντεν. Η φωνή που αρκετοί πίστεψαν ότι ήταν του προέδρου των ΗΠΑ, τους προέτρεπε να μην πάνε να ψηφίσουν αλλά «να φυλάξουν» την ψήφο τους. Οπως σύντομα αποδείχθηκε, το φωνητικό μήνυμα ήταν τελικά δημιούργημα τεχνητής νοημοσύνης.

Ενα από τα πολλά –κατασκευασμένα από τεχνητή νοημοσύνη- deepfakes που έχουν δημιουργηθεί παγκοσμίως και τα οποία εγκυμονούν κινδύνους ακόμα και για την ομαλή διεξαγωγή των επερχόμενων εκλογικών αναμετρήσεων, δεδομένης της ευκολίας με την οποία μπορούν να δημιουργηθούν, της υψηλής ποιότητάς τους αλλά και του ότι εξακολουθούν να διαμοιράζονται χωρίς περιορισμούς.

Οταν ο Ομπάμα έβριζε τον Τραμπ

Τα παραδείγματα από τη χρήση deepfakes που στρέφονται εναντίον πολιτικών προσώπων είναι ατελείωτα. Στα μέσα του 2019 δημοσιεύτηκαν βίντεο που παρουσίαζαν την πρώην πρόεδρο της Βουλής των Αντιπροσώπων των ΗΠΑ, Νάνσι Πελόζι να μιλάει ενώ είναι μεθυσμένη. Μπορεί να επιβεβαιώθηκε ότι τα βίντεο αυτά ήταν πλαστά, αλλά σύμφωνα με εκτιμήσεις, έπληξαν την εικόνα της. Λίγο καιρό νωρίτερα, το 2018, σε άλλο βίντεο, ο πρώην πρόεδρος των ΗΠΑ, Μπαράκ Ομπάμα εμφανίζεται να αποκαλεί τον Ντόναλντ Τραμπ «τελείως και ολοκληρωτικά ηλίθιο». Κι αυτό το βίντεο ήταν deepfake.

Το 2022 δημοσιεύθηκε ένα βίντεο όπου ο πρόεδρος της Ουκρανίας Βολοντίμιρ Ζελένσκι δήλωνε πως η χώρα του θα παραδοθεί στη Ρωσία. Λίγο καιρό αργότερα, ένα άλλο βίντεο έδειχνε τον πρόεδρο της Ρωσίας Βλαντιμίρ Πούτιν να δηλώνει πως η χώρα του κέρδισε τον πόλεμο. Ενώ στη Σλοβακία δύο ημέρες πριν από τις βουλειτικές εκλογές, σε παραποιημένο ηχητικό μήνυμα ακουγόταν ο Μίχαλ Σιμέτσκα, ηγέτης του φιλελεύθερου κόμματος «Προοδευτική Σλοβακία» να συζητά με μια δημοσιογράφο της χώρας για το πώς θα νοθεύσουν τις εκλογές.

Χαρακηριστική είναι και η περίπτωση του Ινδού πολιτικού Πλάνιβελ Τιαγκαρατζαν. Σε ηχητικό, ο Ινδός πολιτικός φέρεται να παραδέχεται διαφθορά στο κόμμα DMK στο οποίο ανήκει. Ο ίδιος δήλωσε ότι επρόκειτο για ένα deepfake, γεγονός όμως που εξακολουθεί να αμφισβητείται από πληθώρα εγχώριων και διεθνών ΜΜΕ.

«Υπερβολικά επικίνδυνη απειλή για τις εκλογές παγκοσμίως»

Σύμφωνα με όσα δήλωσε στην «Κ» ο Ντέιβιντ Ιβαν Χάρις, καθηγητής Δεοντολογίας της Τεχνητής Νοημοσύνης για Ηγέτες (AI Ethics for Leaders) στο αμερικανικό Πανεπιστήμιο του Μπέρκλεϊ, μέσω της χρήσης τεχνολογιών ΑΙ, τα deepfakes είναι πιο εύκολο να δημιουργηθούν, προκειμένου ,να «σαμποτάρουν κάποιον πολιτικό ή πολιτική φιγούρα».

Σύμφωνα με τον κ. Χάρις, «μπορούμε σίγουρα να αναμένουμε μη συναινετικό σεξουαλικό περιεχόμενο σε deepfakes που θα αφορούν -κυρίως γυναίκες- πολιτικούς». Το ζητούμενο σύμφωνα με τον ίδιο, είναι να αντιληφθούμε ότι «τα deeepfakes είναι μια υπερβολικά επικίνδυνη απειλή για τις εκλογές παγκοσμίως. Παρόλα αυτά δεν πρέπει να υπερεκτιμήσουμε τους κινδύνους και να τα αφήσουμε να γίνουν ο λόγος που οι πολίτες θα αμφισβητήσουν την εκλογική διαδικασία».

Οσο πιο ευρεία γίνεται η χρήση των deepfakes, τόσο πιο εύκολο καθίσταται σύμφωνα με τον κ. Χάρις για τους πολιτικούς «να πουν ότι κάτι που όντως έγινε, δεν έγινε. Για παράδειγμα, το 2016 βγήκε μια ηχητική ηχογράφηση που παρουσίαζε τον Τραμπ να υπερηφανεύεται για το πώς κακοποίησε σεξουαλικά γυναίκες. Ο ίδιος το παραδέχθηκε και απολογήθηκε γι’ αυτό, αργότερα όμως είπε ότι ήταν ψεύτικο».

Τα deepfakes μπορεί να έχουν προσωποποιημένο και διαδραστικό περιεχόμενο με τη μορφή συζήτησης, ώστε να νομίζεις ότι έχεις να κάνεις με άνθρωπο.

Σύμφωνα με τον ίδιο, οι εταιρείες που παράγουν εργαλεία τα οποία μπορούν να κατασκευάσουν deepfakes αλλά και οι διαδικτυακές πλατφόρμες που επιτρέπουν τον διαμοιρασμό τους, θα πρέπει «να αρχίσουν να βάζουν ετικέτες σε εικόνες που έχουν δημιουργηθεί από ΑΙ, προκειμένου να το καταστήσουν εύκολο στον κόσμο να τις εντοπίσουν».

Η δυναμική των deepfakes δεν έχει ακόμα χαρτογραφηθεί, αφού σύμφωνα με τον κ. Χάρις, «τίποτα δεν σταματάει μια προεκλογική εκστρατεία, μια εταιρεία ή ένα μεμονωμένο πρόσωπο από το να κατασκευάσει ένα εκατομμύριο ή 100 εκατομμύρια διαφορετικές ρομποτικές κλήσεις που θα έχουν ένα διαφορετικό μήνυμα για διαφορετικούς ανθρώπους. Πρέπει να αντιληφθούμε ότι τα deepfakes μπορεί να έχουν προσωποποιημένο και διαδραστικό περιεχόμενο, με τη μορφή συζήτησης, ώστε να νομίζεις ότι έχεις να κάνεις με άνθρωπο και ενδεχομένως να σε οδηγήσει σε συγκεκριμένες πολιτικές ενέργειες».

«Οι πολιτικοί θα μπορούσαν να γίνουν στόχος εκβιασμού»

Από την πλευρά της, η Θεοδώρα Σκιαδά, εκτελεστική διευθύντρια του μη κερδοσκοπικού οργανισμού Cambrige Local First και CEO στην εταιρεία Tech Policy Consulting, θεωρεί, σύμφωνα με δηλώσεις που παραχώρησε στην «Κ», ότι τα deepfakes μπορούν να οδηγήσουν σε παραπληροφόρηση, αφού δύνανται να χρησιμοποιηθούν για τη δημιουργία ψευδών αφηγήσεων ή για την αλλαγή του πλαισίου δηλώσεων που πραγματοποιούν πολιτικά πρόσωπα. Πρόκειται για κάτι που σύμφωνα με την ίδια, μπορεί να οδηγήσει σε διάβρωση της δημόσιας εμπιστοσύνης, «ή ακόμη και σε απέχθεια για τους πολιτικούς θεσμούς και τις δημοκρατικές διαδικασίες».

Κίνδυνος έγκειται σύμφωνα με την ίδια ακόμα και «για τη διπλωματία, καθώς παραποιημένες δηλώσεις ή πράξεις που αποδίδονται σε παγκόσμιους ηγέτες θα μπορούσαν να οδηγήσουν σε παρεξηγήσεις και συγκρούσεις στις διεθνείς σχέσεις». Ακόμα, πολιτικοί και δημόσια πρόσωπα «θα μπορούσαν να γίνουν στόχοι εκβιασμού, εφόσον απειλούνται με τη δημοσιοποίηση κατασκευασμένου υλικού».

Στην Ελλάδα τα deepfakes έχουν χρησιμοποιηθεί μέχρι στιγμής στην πολιτική μόνο με τη μορφή σάτιρας.

Αναφορικά με το ποιος μπορεί να βρίσκεται πίσω από τη δημιουργία τέτοιων deepfakes, η κ. Σκιαδά ανέφερε ότι «μπορεί να είναι ο οποιοσδήποτε. Στις πρόσφατες εκλογές στην Ταϊβάν, πιστεύεται ότι η μεγάλη διάδοση που παρατηρήθηκε, προήλθε από την Κίνα δεδομένης της έντασης μεταξύ των δύο χωρών. Αλλά επίσης μπορεί να προέλθει από μεμονωμένα πρόσωπα».

Πάντως, δεν είναι όλα τα deepfakes επικίνδυνα, αφού σύμφωνα με την κ. Σκιαδά, «υπάρχουν και ορισμένα σατιρικού περιεχομένου που δεν εμπεριέχουν παραπλανητικό περιεχόμενο». Να σημειωθεί πως στην Ελλάδα τα deepfakes έχουν χρησιμοποιηθεί μέχρι στιγμής στην πολιτική μόνο με τη μορφή σάτιρας, χωρίς όμως να μπορεί να αποκλείσει κανείς εξαιτίας της ευρείας παγκόσμιας διάδοσής τους, ότι δεν θα εμφανιστούν σύντομα και στη χώρα μας.

Αναφορικά με το ποιοι μπορούν να επηρεαστούν από τη χρήση των deepfakes, η κ. Σκιαδά επεσήμανε ότι το γενικό κοινό ενδεχομένως να μην είναι προετοιμασμένο κι έτσι «να δεχθεί αυτή την παραπληροφόρηση χωρίς δεύτερη σκέψη».

«Το μέρισμα του ψεύτη»

Το πρόσφατο αλλοιωμένο ηχητικό όπου χρησιμοποιήθηκε η φωνή του Τζο Μπάιντεν, αποτελεί σύμφωνα με όσα δήλωσε στην «Κ» ο Σκοτ Κρίστιανσον, αναπληρωτής καθηγητής και διευθυντής του Κέντρου Επιχειρηματικότητας και Καινοτομίας στο Trulaske College of Business στο πανεπιστήμιο του Μιζούρι, «ένα σχεδόν τέλειο παράδειγμα της χρήσης των deepfakes για την καταστολή της συμμετοχής των ψηφοφόρων».

Η χρήση των deepfakes είναι ιδιαιτέρως προσφιλής σύμφωνα με τον κ. Κρίστιανσον από «αυταρχικά καθεστώτα, όπως η Ρωσία και η Κίνα, προκειμένου με φτηνό και εύκολο τρόπο να παρεμβαίνουν στις εκλογές δημοκρατικών κυβερνήσεων».

Πού είναι το όριο μεταξύ της νόμιμης κριτικής και της παρωδίας των πολιτικών μας ηγετών –ένα κοινό δικαίωμα στις δημοκρατικές κυβερνήσεις- και της σκόπιμης παραπλάνησης του κοινού;».

Πάντως, δεν λείπουν και τα deepfakes παρωδία όπως αυτό που αφορούσε τον πρώην Ιταλό πρωθυπουργό Ματέο Ρέντσι και τον εμφάνιζε σε μια σατιρική εκπομπή να βρίζει πολιτικούς του αντιπάλους. Μπορεί βάσει των όσων σχολίασε ο κ. Κρίστιανσον, αυτό το deepfake να έγινε «για πλάκα», εντούτοις όπως αναρωτήθηκε, «πού είναι το όριο μεταξύ της νόμιμης κριτικής και της παρωδίας των πολιτικών μας ηγετών –ένα κοινό δικαίωμα στις δημοκρατικές κυβερνήσεις- και της σκόπιμης παραπλάνησης του κοινού;».

«Ας υποθέσουμε», είπε ο κ. Κρίστιανσον «ότι εμφανίζεται ένα βίντεο με έναν πολιτικό υποψήφιο να λέει κάτι κακό και το κλιπ αυτό είναι αληθινό. Τώρα, ο υποψήφιος μπορεί να πει στους υποστηρικτές του: “Ηταν ένα deepfake”. Το όφελος που αποκομίζουν οι συγκεκριμένοι είναι γνωστό ως το μέρισμα του ψεύτη».

«Οι άνθρωποι είναι ιδιαίτερα ευάλωτοι στο να εμπιστεύονται βαθιά ψεύτικες πληροφορίες»

Από την πλευρά του ο Μάρκους Απελ, πρόεδρος του τμήματος Ψυχολογίας της Επικοινωνίας και των Νέων Μέσων του Ινστιτούτου Ανθρωπίνων Μέσων Πληροφορικής του πανεπιστημίου Würzburg της Γερμανίας, δήλωσε στην «Κ» ότι δεδομένου πως η χρήση των deepfakes μπορεί να είναι αρκετά καλή, ενδέχεται να επηρεάσουν ερχόμενες εκλογικές αναμετρήσεις. Αλλωστε, συμφωνα με τον ίδιο, οι άνθρωποι «είναι ιδιαίτερα ευάλωτοι στο να εμπιστεύονται βαθιά ψεύτικες πληροφορίες που κάνουν το αντίπαλο κόμμα να φαίνεται κακό και να απαξιώσουν κάθε ανεπιθύμητη πληροφορία ως ψέμα. Για παράδειγμα, αυτό φαίνεται να αποτελεί μέρος της επικοινωνιακής στρατηγικής του Ντόναλντ Τραμπ».

Αλλωστε, όπως υπογράμμισε, «κάποιοι άνθρωποι θέλουν τόσο πολύ να πιστέψουν ορισμένα πράγματα, ώστε ακόμη και ένα ατελές deepfake να πετυχαίνει τον στόχο».

Στην ερώτηση εάν πολιτικοί θα μπορούσαν να χρησιμοποιήσουν deepfakes προκειμένου να πλήξουν τους πολιτικούς τους αντιπάλους, ο κ. Απελ σχολίασε ότι αυτό μπορεί να μη γίνεται από τους ίδιους και τον στενό τους κύκλο, «αλλά από άτομα και ομάδες στο περιθώριο. Επίσης, δυνάμεις εκτός της χώρας μπορεί να έχουν συμφέρον να διαταραχθεί ένα πολιτικό σύστημα ή κάποιο κόμμα να πάει καλά στις εκλογές».